┤¾─Żą═╝╝ąg(sh©┤)īŹ(sh©¬)█`Ż©╚²Ż®Ż³10ĘųńŖė├LangChain║═Llama 2┤“įņą─ņ`»¤ė·ÖC(j©®)Ų„╚╦

ĪĪĪĪ╔ŽŲ┌╬─š┬╬ęéāīŹ(sh©¬)¼F(xi©żn)┴╦Llama 2-chat-7B─Żą═Ą─įŲČ╦▓┐╩║══Ų└ĒŻ¼▒ŠŲ┌╬─š┬╬ęéāīóė├“LangChain+Llama 2”Ą─╝▄śŗ(g©░u)┤“įņę╗éĆ(g©©)Č©ųŲ╗»Ą─ą─ņ`»¤ė·ÖC(j©®)Ų„╚╦ĪŻėąŽÓĻP(gu©Īn)ų¬ūR(sh©¬)▒│Š░Ą─ūxš▀┐╔ęįų▒ĮėķåūxĪĖīŹ(sh©¬)æ(zh©żn)Ī╣▓┐ĘųĪŻ

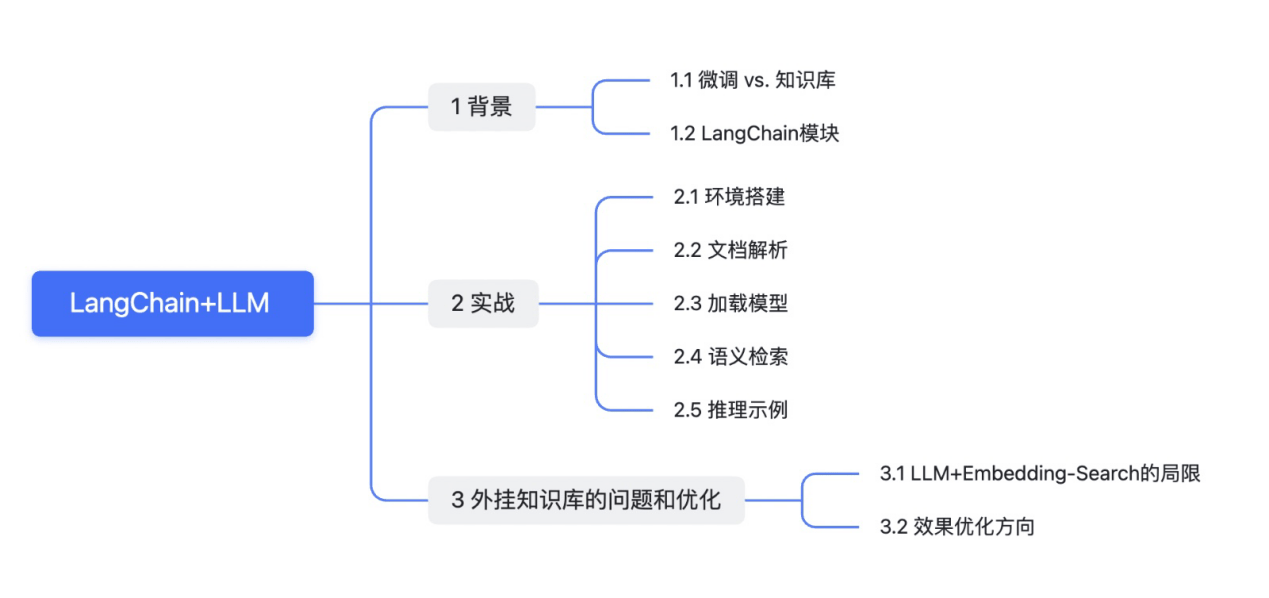

ĪĪĪĪ1 ▒│Š░

ĪĪĪĪ1.1 ╬óš{(di©żo) vs. ų¬ūR(sh©¬)Äņ(k©┤)

ĪĪĪĪė╔ė┌┤¾─Żą═į┌┤╣ų▒ąąśI(y©©)ŅI(l©½ng)ė“Ą─å¢(w©©n)┤ą¦╣¹╚įėą┤²╠ß╔²Ż¼ę“┤╦Ż¼ŅI(l©½ng)ė“ų¬ūR(sh©¬)Ą─ūó╚ļ│╔×ķ┴╦ūŅų▒ĮėĄ─ĮŌøQĘĮ░Ėų«ę╗ĪŻų¬ūR(sh©¬)ūó╚ļĘĮĘ©┐╔ęįĘų×ķŅI(l©½ng)ė“╬óš{(di©żo)(Fine-tuning)║══ŌÆņų¬ūR(sh©¬)Äņ(k©┤)(Knowledge Base)ā╔ĘNĪŻ

ĪĪĪĪ1. ŅI(l©½ng)ė“╬óš{(di©żo)

ĪĪĪĪ╬óš{(di©żo)╩Ū═©▀^(gu©░)╔┘┴┐╠žČ©ė├└²Ą─į÷┴┐öĄ(sh©┤)ō■(j©┤)ī”(du©¼)╗∙ĄA(ch©│)─Żą═▀M(j©¼n)ąą▀M(j©¼n)ę╗▓Įė¢(x©┤n)ŠÜŻ¼Ė─ūāŲõ╔±Įø(j©®ng)ŠW(w©Żng)Įj(lu©░)ųąĄ─ģóöĄ(sh©┤)ÖÓ(qu©ón)ųžĪŻ╬óš{(di©żo)▀mė├ė┌╚╬äš(w©┤)╗“ė“Č©┴x├„┤_Ż¼ŪęėąūŃē“Ą─ś╦(bi©Īo)ėøöĄ(sh©┤)ō■(j©┤)Ą─ł÷(ch©Żng)Š░Ż¼▒╚╚ń’L(f©źng)Ė±╬óš{(di©żo)ĪŻ─┐Ū░│Żė├Ą─╬óš{(di©żo)ĘĮĘ©░³└©FreezeŻ¼P-tuning║═LoRAŻ¼ŽÓĻP(gu©Īn)╝Ü(x©¼)╣Ø(ji©”)Ģ■(hu©¼)į┌Ž┬Ų┌╬─š┬ųąįö╝Ü(x©¼)ĮķĮBĪŻ

ĪĪĪĪ╚╗Č°Ż¼╬óš{(di©żo)ĘĮĘ©Ą─▓╗ūŃų«╠Äį┌ė┌Ż║

ĪĪĪĪ▪ Ė▀┘|(zh©¼)┴┐ė¢(x©┤n)ŠÜöĄ(sh©┤)ō■(j©┤)╝»Ą─śŗ(g©░u)Į©Ż¼╬óš{(di©żo)ė¢(x©┤n)ŠÜ╦∙ąĶĄ─╦Ń┴”ęį╝░╬óš{(di©żo)─Żą═Č©Ų┌Ė³ą┬Ą╚ķ_(k©Īi)õNČ╝▓╗╚▌ąĪėU

ĪĪĪĪ▪ įćÕe(cu©░)│╔▒Š▌^Ė▀Ż¼╠žČ©ŅI(l©½ng)ė“öĄ(sh©┤)ō■(j©┤)ę╗░ŃļyęįĖ▓╔w─Żą═ęčīW(xu©”)ĄĮĄ─ģóöĄ(sh©┤)Ż¼Ūę┐╔─▄Ģ■(hu©¼)ī¦(d©Żo)ų┬─Żą═Ųõ╦¹Ž┬ė╬╚╬äš(w©┤)Ą─▒Ē¼F(xi©żn)Ž┬ĮĄ

ĪĪĪĪ2. ═ŌÆņų¬ūR(sh©¬)Äņ(k©┤)

ĪĪĪĪ═ŌÆņų¬ūR(sh©¬)Äņ(k©┤)Ą─▒Š┘|(zh©¼)į┌ė┌▓╗ą▐Ė─╗∙ū∙─Żą═ģóöĄ(sh©┤)Ż¼═©▀^(gu©░)╠ß╩Šį~╣ż│╠(Prompt Engineering)īó╠žČ©ų¬ūR(sh©¬)ū„×ķpromptųąĄ─contextŻ¼╝┤š┘╗žŽÓĻP(gu©Īn)ąįūŅĖ▀Ą─ÄūéĆ(g©©)╬─ÖnŻ¼ūī─Żą═Ęų╬÷▀@ą®╠N(y©┤n)║¼ų¬ūR(sh©¬)║¾Ż¼▓óĘĄ╗ž┤░ĖĪŻų¬ūR(sh©¬)Äņ(k©┤)▀m║Žę¬Ū¾▌ö│÷├„┤_ŪęŠ½Č╚Ė▀Ą─╚╬äš(w©┤)ĪŻ

ĪĪĪĪŽÓī”(du©¼)ė┌╬óš{(di©żo)Ż¼ų¬ūR(sh©¬)Äņ(k©┤)Ą─ā×(y©Łu)ä▌(sh©¼)į┌ė┌Ż║

ĪĪĪĪ▪ ╗ž┤Š½┤_Č╚Ė³Ė▀Ż¼╗∙ė┌ŽÓĻP(gu©Īn)╬─ÖnųąĄ─ūŅŽÓĻP(gu©Īn)╠žČ©Č╬┬õ▀M(j©¼n)ąąšZ(y©│)┴x╦č╦„─▄Ž¹│²▓ķįāŲń┴xęį╔·│╔Ė³Š½┤_Ą─┤░Ė

ĪĪĪĪ▪ ▀mæ¬(y©®ng)ąįĖ³ÅŖ(qi©óng)Ż¼ė├æ¶┐╔ęį═©▀^(gu©░)▌p╦╔Ė³ą┬ą┼Žóį┤üĒ(l©ói)š{(di©żo)š¹║═▀m┼õą┬Ą─ŅI(l©½ng)ė“

ĪĪĪĪĄ½┤¾─Żą═╔ŽŽ┬╬─┤░┐┌ķL(zh©Żng)Č╚Ą─Ž▐ųŲ║═PromptĄ─śŗ(g©░u)įņĄ╚ę“╦žÄ¦üĒ(l©ói)Ą─Øōį┌Š½Č╚Ž┬ĮĄę▓ąĶę¬╝{╚ļų¬ūR(sh©¬)Äņ(k©┤)śŗ(g©░u)Į©Ą─┐╝┴┐ĪŻ

ĪĪĪĪ×ķ┴╦┤“įņ╠žČ©ŅI(l©½ng)ė“(Domain-specific Knowledge)Ą─ų¬ūR(sh©¬)å¢(w©©n)┤ŽĄĮy(t©»ng)Ż¼╬ęéāąĶę¬ĮĶų·╠ß╣®┴╦═ŌÆņų¬ūR(sh©¬)Äņ(k©┤)Ą─╦č╦„ĘĮ░ĖLangChain┐“╝▄ĪŻ

ĪĪĪĪ1.2 LangChain─ŻēK

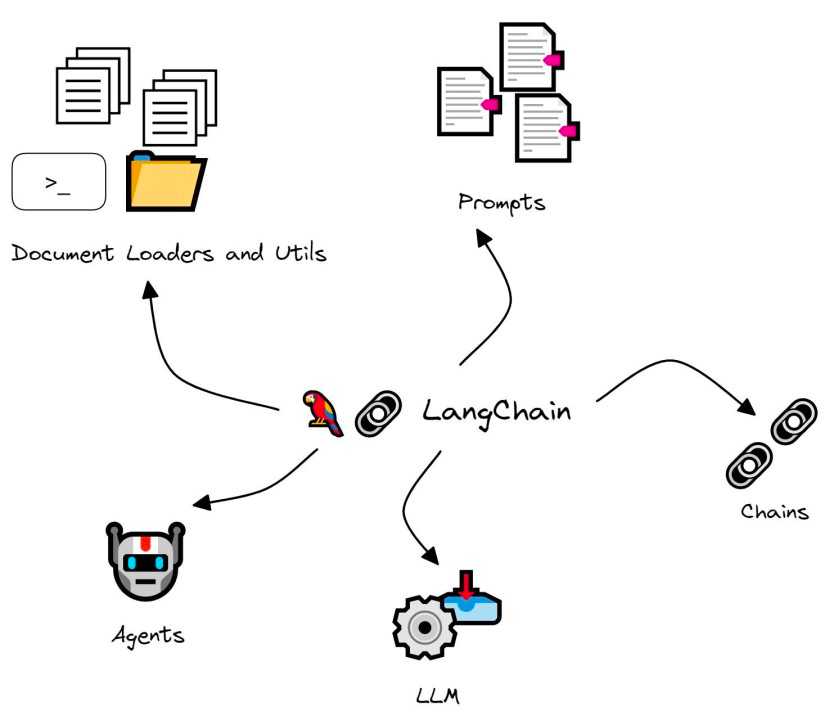

ĪĪĪĪLangChain╩Ūę╗éĆ(g©©)ė╔šZ(y©│)čį─Żą═“ī(q©▒)äė(d©░ng)Ą─ė├ė┌ķ_(k©Īi)░l(f©Ī)æ¬(y©®ng)ė├│╠ą“Ą─┐“╝▄ĪŻ

ĪĪĪĪLangChainų„ꬥ─ā╔éĆ(g©©)─▄┴”╩ŪŻ║

ĪĪĪĪa. Data-awareŻ║īó▓╗═¼öĄ(sh©┤)ō■(j©┤)į┤Įė╚ļĄĮšZ(y©│)čį─Żą═ųą

ĪĪĪĪb. AgenticŻ║į╩įSšZ(y©│)čį─Żą═║═LangChainŁh(hu©ón)Š│Į╗╗ź

ĪĪĪĪLangChainĄ─║╦ą──ŻēK░³└©ModelsŻ¼PromptsŻ¼ChainsŻ¼IndexesŻ¼AgentsĄ╚ [1]ĪŻī”(du©¼)ė┌├┐ę╗éĆ(g©©)─ŻēKŻ¼LangChainČ╝╠ß╣®┴╦ś╦(bi©Īo)£╩(zh©│n)╗»Ą─┐╔═žš╣Įė┐┌ĪŻ

ĪĪĪĪłD1Ż║LangChain▓┐Ęų─ŻēK [2]

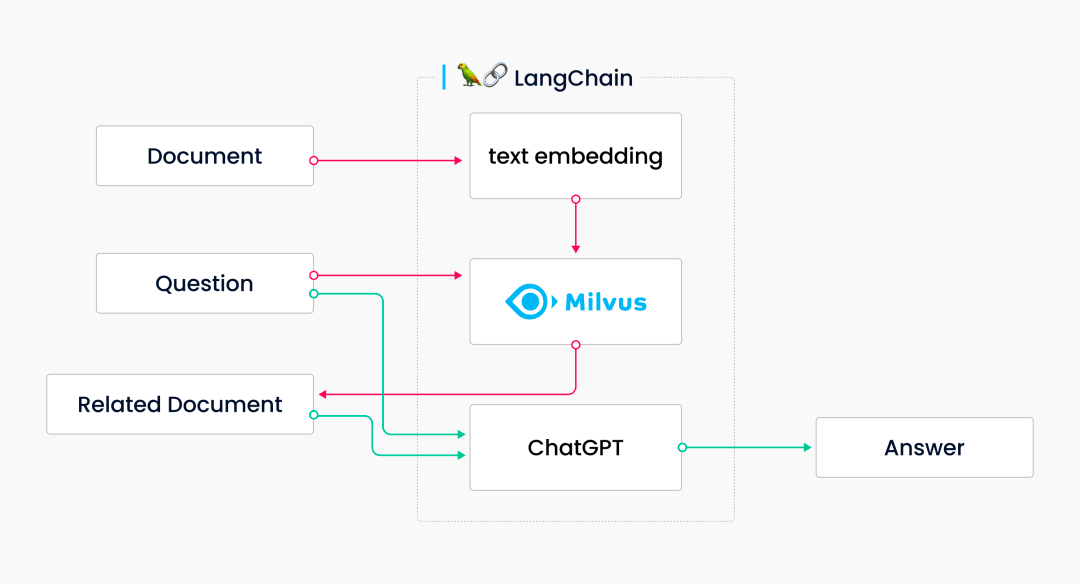

ĪĪĪĪ│²┴╦ė├LLM Wrapper┐╔ęįĮė╚ļ▒ŖČÓĄ─┤¾─Żą═(╚ń OpenAIĪóCohereĪóHugging Face)Ż¼LangChain═¼Ģr(sh©¬)ę▓═©▀^(gu©░)VectorStore WrapperĮė┐┌╝»│╔┴╦ų„┴„Ą─Ž“┴┐öĄ(sh©┤)ō■(j©┤)Äņ(k©┤)(╚ń MilvusĪóPineconeĪóChromaĄ╚)üĒ(l©ói)ā×(y©Łu)╗»šZ(y©│)┴x╦č╦„ĪŻLangChain─▄Įė╚ļĄ─öĄ(sh©┤)ō■(j©┤)ŅÉą═║Ł╔w┴╦╬─▒ŠĪóPPTĪółDŲ¼ĪóHTMLĪóPdfĄ╚ĘŪĮY(ji©”)śŗ(g©░u)╗»╬─╝■ĪŻŽÓ▌^ė┌é„Įy(t©»ng)öĄ(sh©┤)ō■(j©┤)Äņ(k©┤)Ą─Š½┤_╦č╦„Ż¼╝┤═Ļ╚½Ųź┼õŻ¼Ž“┴┐öĄ(sh©┤)ō■(j©┤)Äņ(k©┤)╩╣ė├ūŅÓÅĮ³(Approximate Nearest NeighborŻ¼ANN)╦ŃĘ©║═ŽÓ╦ŲČ╚Č╚┴┐(╚ńėÓŽęŽÓ╦ŲČ╚Ż¼ā╚(n©©i)ĘeĄ╚)üĒ(l©ói)šęĄĮ║═▓ķįāå¢(w©©n)Ņ}ūŅŽÓ╦ŲĄ─Ž“┴┐ĪŻ╗∙ė┌▒ŠĄžų¬ūR(sh©¬)Äņ(k©┤)å¢(w©©n)┤Ą─┤¾ų┬┴„│╠╚ńŽ┬Ż║

ĪĪĪĪ▀@└’ęįMilvusöĄ(sh©┤)ō■(j©┤)Äņ(k©┤)║═ChatGPTū„×ķ╩Š└²Ż║

ĪĪĪĪłD2Ż║LangChian + Milvus + ChatGPT pipeline [3]

ĪĪĪĪ2 īŹ(sh©¬)æ(zh©żn)

ĪĪĪĪ─┐Ū░Ż¼╬ęéāęčĮø(j©®ng)▓ĮŌ═Ļ┴╦LangChain+LLM╬─Önå¢(w©©n)┤Ą─┤¾ų┬µ£┬ĘŻ¼ĮėŽ┬üĒ(l©ói)╬ęéāš²╩Į▀M(j©¼n)╚ļīŹ(sh©¬)æ(zh©żn)Łh(hu©ón)╣Ø(ji©”)ĪŻ

ĪĪĪĪ2.1 Łh(hu©ón)Š│┤ŅĮ©

ĪĪĪĪa. ░▓čbLangChain

ĪĪĪĪ┤_▒ŻPython ░µ▒Š≥ 3.8.1 Ūę <4.0ĪŻ

ĪĪĪĪb. ▓┐╩LLama 2

ĪĪĪĪĻP(gu©Īn)ė┌Llama 2─Żą═Ą─▓┐╩Ż¼įöŪķ┐╔ģóęŖ(ji©żn)

ĪĪĪĪi. ╔ŽŲ┌╬─š┬“┤¾─Żą═╝╝ąg(sh©┤)īŹ(sh©¬)█`(Č■)|ĻP(gu©Īn)ė┌Llama 2─ŃąĶę¬ų¬Ą└Ą──Ūą®╩┬ā║”Ż║https://mp.weixin.qq.com/s/9WISpAN91duVYVwfkZQaDw

ĪĪĪĪii. UCloud╣┘ĘĮĄ─“LLaMA2 ─Żą═┐ņ╦┘▓┐╩”╬─ÖnŻ║https://docs.ucloud.cn/gpu/practice/LLaMA2?id=llama2-─Żą═┐ņ╦┘▓┐╩

ĪĪĪĪc. Ž┬▌dEmbedding ─Żą═

ĪĪĪĪ▀@└’╬ęéā▀xō±text2vec-large-chinese [4]▀@éĆ(g©©)Embedding─Żą═Ż¼Ž┬▌dĄžųĘ×ķŻ║https://huggingface.co/GanymedeNil/text2vec-large-chinese

ĪĪĪĪī”(du©¼)ė┌ųą╬─Ą─ł÷(ch©Żng)Š░Ż¼ę▓ėąŲõ╦¹ā×(y©Łu)ąŃĄ─ķ_(k©Īi)į┤─Żą═┐╔╣®▀xō±Ż¼╚ńm3e║═bgeĄ╚[5]ĪŻ

ĪĪĪĪd. Ž┬▌döĄ(sh©┤)ō■(j©┤)╝»

ĪĪĪĪą─ņ`ļu£½╬─▒ŠöĄ(sh©┤)ō■(j©┤)╝»Ż║https://huggingface.co/datasets/soulteary/warm-chicken-soup/

ĪĪĪĪ▀@éĆ(g©©)öĄ(sh©┤)ō■(j©┤)╝»╩ŪÅ─GoogleŠW(w©Żng)Ēō(y©©)╔Ž┼└╚ĪĄ─ę╗ą®ą─ņ`ļu£½ę²ė├Č╠╬─Ż¼╣▓░³║¼631Śl╬─▒Š

ĪĪĪĪ2.2 ╬─ÖnĮŌ╬÷

ĪĪĪĪa. ╝ė▌döĄ(sh©┤)ō■(j©┤)╝»

ĪĪĪĪLangChainī”(du©¼)ė┌▓╗═¼Ė±╩ĮĄ─öĄ(sh©┤)ō■(j©┤)į┤ā╚(n©©i)ų├┴╦▓╗═¼Ą─ĮŌ╬÷─_▒ŠŻ¼ūŅĮK▀@ą®öĄ(sh©┤)ō■(j©┤)Č╝īó▐D(zhu©Żn)ōQ×ķ╝ātxt╬─▒ŠĖ±╩ĮŻ¼ęįīŹ(sh©¬)¼F(xi©żn)╬─▒Šś╦(bi©Īo)£╩(zh©│n)╗»ĪŻ

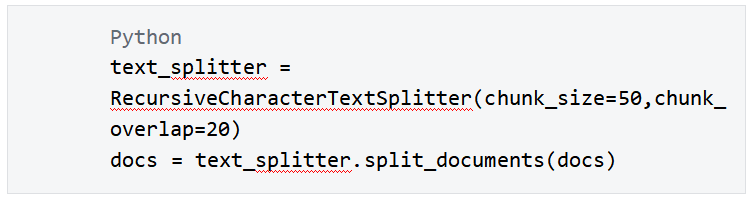

ĪĪĪĪb. ╬─▒ŠŪąĘų

ĪĪĪĪ╬─▒ŠŪąĘųųąĄ─chunk_sizeųĖČ©┴╦ŪąĘų║¾Ą─╬─▒ŠēKĄ─ūų?j©½n)?sh©┤)Ż¼chunk_overlapųĖČ©┴╦ŪąĘų╬─▒ŠēKų«ķgĄ─ųž»Būų?j©½n)?sh©┤)ĪŻė╔ė┌ļu£½ę²ė├╬─▒Š┐éķL(zh©Żng)Č╚▌^Č╠Ż¼Ūę╬─▒Šā╚(n©©i)▓┐šZ(y©│)┴xĻP(gu©Īn)┬ō(li©ón)Č╚Ė▀Ż¼╦∙ęį▀@└’Ą─chunk_sizeįO(sh©©)ų├×ķ50Ż¼chunk_overlapįO(sh©©)ų├×ķ20ĪŻ

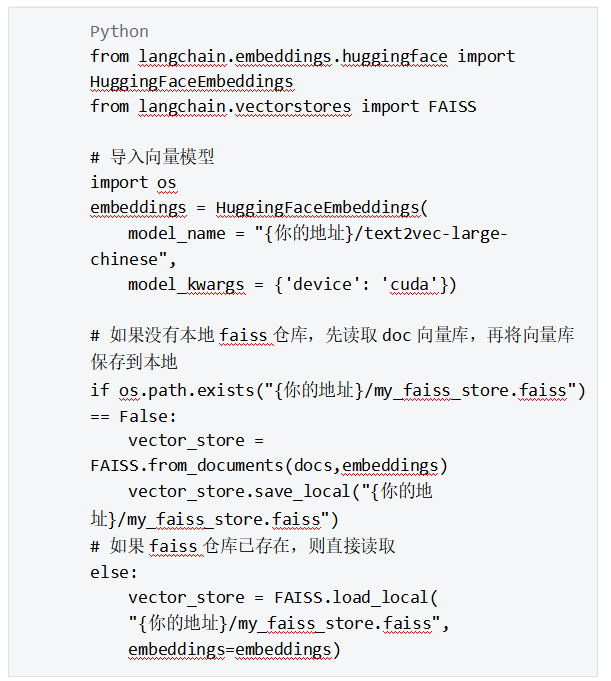

ĪĪĪĪc. ╬─▒ŠŪČ╚ļ║═Ž“┴┐Äņ(k©┤)

ĪĪĪĪ╬─▒ŠŪąĘų║¾Ż¼╬ęéāąĶę¬īó╬─▒Š▀M(j©¼n)ąąŽ“┴┐╗»▒Ē╩ŠŻ¼īóŲõė│╔õ×ķĄ═ŠS│Ē├▄Ą─Ž“┴┐▓ó┤µā”(ch©│)ĄĮ╚╗Ž“┴┐öĄ(sh©┤)ō■(j©┤)Äņ(k©┤)ųąĪŻŽ“┴┐öĄ(sh©┤)ō■(j©┤)Äņ(k©┤)▀xė├┴╦¤o(w©▓)ąĶūóāį(c©©)Ą─FAISSĪŻ

ĪĪĪĪ2.3 ╝ė▌d─Żą═

ĪĪĪĪ2.4 šZ(y©│)┴xÖz╦„

ĪĪĪĪĮėŽ┬üĒ(l©ói)Ż¼╬ęŠ═─▄Ė∙ō■(j©┤)śŗ(g©░u)Į©║├Ą─Ž“┴┐öĄ(sh©┤)ō■(j©┤)Äņ(k©┤)š┘╗žī”(du©¼)æ¬(y©®ng)╬─▒ŠŲ¼Č╬ĪŻ

ĪĪĪĪa. Ž“┴┐╗»š┘╗ž

ĪĪĪĪFAISS─¼šJ(r©©n)╩╣ė├L2(ÜW╩ĮŠÓļx)Ż¼š┘╗žĄ─╬─Ön░┤ššŽÓ╦ŲČ╚ĮY(ji©”)╣¹Å─┤¾ĄĮąĪ┼┼ą“ĪŻ

ĪĪĪĪb. įO(sh©©)ų├╠ß╩Šį~─Ż░Õ

ĪĪĪĪęįŽ┬╩ŪLlama 2─¼šJ(r©©n)Ą─╠ß╩Šį~─Ż░Õ

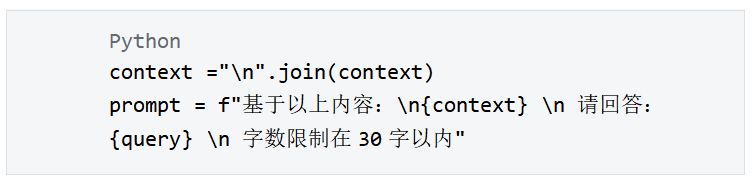

ĪĪĪĪ╬ęéā┐╔ęįģó┐╝╔Ž├µĄ──Ż░ÕŻ¼Ė∙ō■(j©┤)ł÷(ch©Żng)Š░Č©ųŲ╗»ūį╝║Ą──Ż░ÕüĒ(l©ói)Ų┤Įėquery║═š┘╗žĮY(ji©”)╣¹

ĪĪĪĪ2.5 ═Ų└Ē╩Š└²

ĪĪĪĪ╬ęéāī”(du©¼)LLMĄ─ģóöĄ(sh©┤)▀M(j©¼n)ąąįO(sh©©)ų├Ż¼└²╚ńūŅ┤¾┴Ņ┼Ų(max_new_tokens)ĪóūŅĖ▀kųĄ(top_k)Īó£žČ╚(temperature)║═ųžÅ═(f©┤)æ═┴P(repetition_penalty)Ą╚Ą╚ĪŻūŅ║¾Ż¼īóprompt╬╣Įo─Żą═ĪŻ

ĪĪĪĪ3 ═ŌÆņų¬ūR(sh©¬)Äņ(k©┤)Ą─å¢(w©©n)Ņ}║═ā×(y©Łu)╗»

ĪĪĪĪ3.1 LLM+Embedding-SearchĄ─ŠųŽ▐

ĪĪĪĪ═ŌÆņų¬ūR(sh©¬)Äņ(k©┤)īóė├æ¶å¢(w©©n)Ņ}║═▒ŠĄžų¬ūR(sh©¬)Ž“┴┐╗»Ż¼▒╚▌^ā╔š▀Ą─Ž“┴┐ŽÓ╦ŲČ╚(Vector Similarity)▀M(j©¼n)ąąš┘╗žĪŻ╚╗Č°Ż¼▀@ĘN╚½┴┐Ą─Embedding-Searchį┌├µī”(du©¼)ČÓų¬ūR(sh©¬)³c(di©Żn)Š█║Ž╠Ä└ĒĄ─ł÷(ch©Żng)Š░Ž┬Ż¼┤µį┌š┘╗žŠ½Č╚Ą═Ą─å¢(w©©n)Ņ}ĪŻę“?y©żn)ķų¬ūR(sh©¬)Äņ(k©┤)Ą─śŗ(g©░u)Į©╩Ūī”(du©¼)å╬éĆ(g©©)ų¬ūR(sh©¬)³c(di©Żn)▀M(j©¼n)ąą╦„ę²Ż¼Č°ĘŪī”(du©¼)▓╗═¼ų¬ūR(sh©¬)³c(di©Żn)Ą─┼┼┴ąĮM║ŽĘųäe╦„ę²ĪŻ

ĪĪĪĪ×ķ┴╦▒▄├Ōš┘╗ž▀z┬®Ż¼ų▒ė^Ą─╠Ä└ĒĘĮĘ©░³└©ĮĄĄ═ŽÓ╦ŲČ╚ķōųĄ(similarity score threshold)║═į÷╝ėš┘╗ž?c©ói)?sh©┤)┴┐(top_k)Ż¼Ą½▀@▓╗├ŌĢ■(hu©¼)ę²╚ļ¤o(w©▓)ĻP(gu©Īn)Ą─ų¬ūR(sh©¬)³c(di©Żn)įļ┬ĢŪęį÷╝ė║═LLMĮ╗╗źĄ─tokenķ_(k©Īi)õNĪŻ

ĪĪĪĪ3.2 ą¦╣¹ā×(y©Łu)╗»ĘĮŽ“

ĪĪĪĪ3.2.1 ęŌłDūR(sh©¬)äe║═š┘╗žā×(y©Łu)╗»

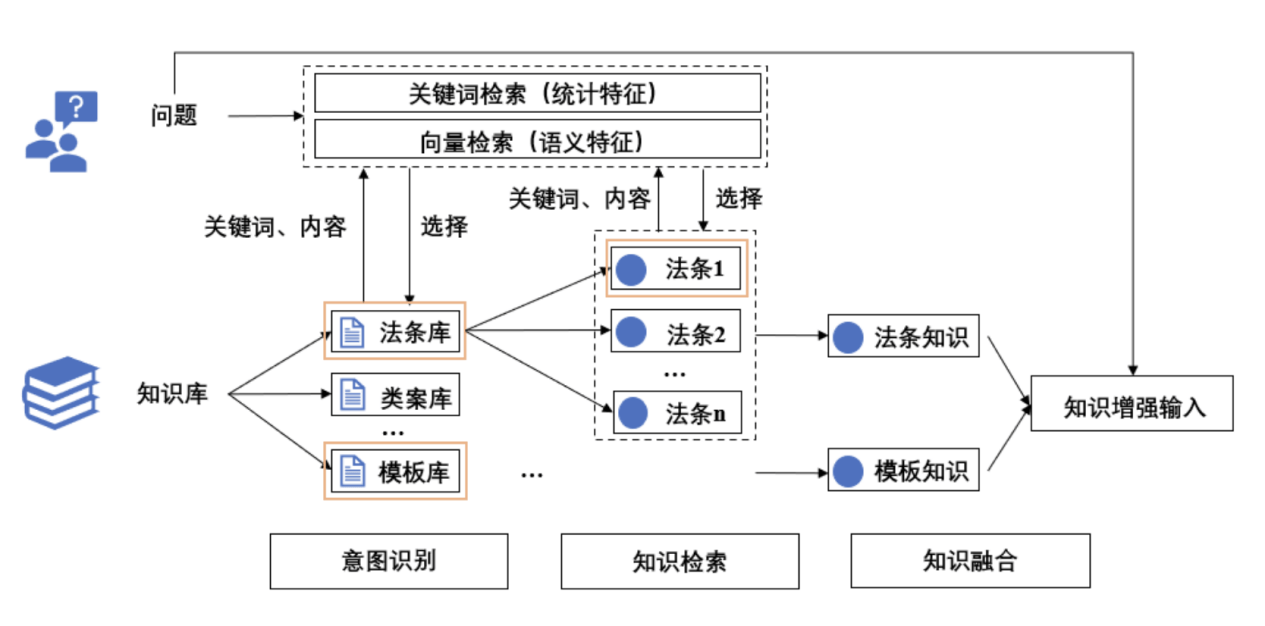

ĪĪĪĪ╠ß╔²å¢(w©©n)┤ŽĄĮy(t©»ng)Ą─Š½Č╚┐╔ęįÅ─ęŌłDūR(sh©¬)äe║═š┘╗žā×(y©Łu)╗»ā╔éĆ(g©©)ĮŪČ╚┐╝æ]Ż¼Ūęā╔š▀Č╝┐╔ęįė├ĻP(gu©Īn)µIį~▒Ē╩ŠŻ¼╝┤Å─ų▒Įėīóė├æ¶query║═ų¬ūR(sh©¬)³c(di©Żn)▀M(j©¼n)ąąembedding▐D(zhu©Żn)ūā?y©Łu)ķī?du©¼)ā╔š▀╠ß╚ĪĻP(gu©Īn)µIį~║¾į┘▀M(j©¼n)ąąŲź┼õĪŻęŌłDūR(sh©¬)äe┐╔ęį═©▀^(gu©░)ĻP(gu©Īn)µIį~╠ß╚Ī(Information Extraction, IE)║═▓█╬╗╠Ņ│õ(Slot FillingŻ¼SF)īŹ(sh©¬)¼F(xi©żn)ĪŻŻ║

ĪĪĪĪ1. ĻP(gu©Īn)µIį~╠ß╚Ī

ĪĪĪĪa. ├µŽ“query——▓█╬╗╠Ņ│õ

ĪĪĪĪ└¹ė├LLM╦╝ŠSµ£(Chain-of-ThoughtŻ¼COT)Ą─╠ß╩Š─▄┴”üĒ(l©ói)ę²ī¦(d©Żo)ė├æ¶ČÓ▌åī”(du©¼)įÆ▓ó▀M(j©¼n)ąąą┼Žó┐éĮY(ji©”)ĪŻßśī”(du©¼)╬ęéāĄ─ą─ņ`»¤ė·ÖC(j©®)Ų„╚╦Ą─ł÷(ch©Żng)Š░Ż¼▒╚╚ńė├æ¶▓ķįāą─ņ`ļu£½Ą─ŠõūėŻ¼─Ū├┤Š═ę¬Ū¾ė├æ¶Ą─╠ß╣®─Ļ²gČ╬Ż¼ŪķŠwå¢(w©©n)Ņ}║═ŪķĖąąĶŪ¾Ą╚ą┼ŽóĪŻšZ(y©│)┴x▓█Ė±╩Į╚ńŽ┬Ż║

ĪĪĪĪb. ├µŽ“ų¬ūR(sh©¬)³c(di©Żn)——╦„ę²╚ļ┐┌

ĪĪĪĪī”(du©¼)ė┌ų¬ūR(sh©¬)³c(di©Żn)┐╔ęįÅ─ęįŽ┬ā╔éĆ(g©©)ĘĮ├µ┐╝æ]Ż║

ĪĪĪĪi. ī”(du©¼)ŽÓ═¼ų¬ūR(sh©¬)³c(di©Żn)Į©┴óČÓ╝ē(j©¬)╦„ę²Ż¼ėąų·ė┌īŹ(sh©¬)¼F(xi©żn)ī”(du©¼)ŠSČ╚▓ķįāĪŻ▒╚╚ńī”(du©¼)ę╗╬╗ŖW▀\(y©┤n)╣┌▄ŖĄ─ąš├¹Ż¼Ėé(j©¼ng)┘ÉĒŚ(xi©żng)─┐Ż¼─Ļ²gŻ¼½@¬ä(ji©Żng)Ģr(sh©¬)ķgĄ╚ĘųäeĮ©┴ó╦„ę²ĪŻ

ĪĪĪĪii. īóų¬ūR(sh©¬)Äņ(k©┤)▐D(zhu©Żn)╗»×ķęįĻP(gu©Īn)ŽĄ╚²į¬ĮM×ķ║╦ą─Ą─ų¬ūR(sh©¬)łDūVĪŻ╚²į¬ĮMĄ─│ķ╚Ī│²┴╦é„Įy(t©»ng)Ą─├³├¹īŹ(sh©¬)¾wūR(sh©¬)äe(NER)Ą╚ĘĮĘ©Ż¼ę▓┐╔ęį═©▀^(gu©░)promptūī┤¾─Żą═üĒ(l©ói)▀M(j©¼n)ąą│ķ╚ĪĪŻ

ĪĪĪĪ╗∙ė┌ĻP(gu©Īn)µIį~Ą─embedding╚ļÄņ(k©┤)║═╦č╦„┴„│╠╚ńŽ┬Ż║

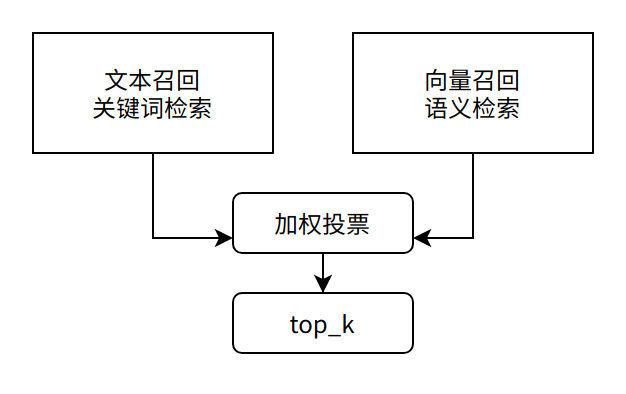

ĪĪĪĪ2. ČÓ┬Ęš┘╗ž

ĪĪĪĪŅÉ╦Ųė┌BertĢr(sh©¬)┤·Ą─┤╣ų▒ŅI(l©½ng)ė“å¢(w©©n)┤ŽĄĮy(t©»ng)Ż¼╬ęéā┐╔ęįīóšZ(y©│)┴xÖz╦„║═é„Įy(t©»ng)Ą─Elasticsearch(ES)ĻP(gu©Īn)µIį~╦č╦„▓󹹯¼ī”(du©¼)ā╔š▀▀M(j©¼n)ąą╝ėÖÓ(qu©ón)┤“Ęų═ČŲ▒üĒ(l©ói)½@╚ĪūŅĮKĄ─top_kĪŻ

ĪĪĪĪ─┐Ū░ŅÉ╦Ųė┌ęį╔Žā×(y©Łu)╗»╦╝┬ĘęčĮø(j©®ng)┬õĄžĄ─ėą“õøå¢(w©©n)”Ę©┬╔┤¾─Żą═ [6]Ż¼Ųõ╗∙ū∙─Żą═×ķBaichuan-7BĪŻõøå¢(w©©n)ų¬ūR(sh©¬)į÷ÅŖ(qi©óng)Ą─═Ļš¹µ£┬Ę╚ńłD3ĪŻųĄĄ├ūóęŌĄ─╩ŪŻ¼õøå¢(w©©n)į┌ų¬ūR(sh©¬)Äņ(k©┤)ųąī”(du©¼)├┐ę╗éĆ(g©©)ų¬ūR(sh©¬)³c(di©Żn)╩Ūęį [key, value] pair ą╬╩Į┤µā”(ch©│)Ą─ĪŻkey╩Ūų¬ūR(sh©¬)³c(di©Żn)Ą─ā╚(n©©i)╚▌║å(ji©Żn)ĮķŻ¼ė├ė┌Öz╦„;value╩Ūų¬ūR(sh©¬)³c(di©Żn)Ą─Š▀¾wā╚(n©©i)╚▌Ż¼ė├ė┌─Żą═▌ö╚ļĪŻīŹ(sh©¬)¼F(xi©żn)╝Ü(x©¼)╣Ø(ji©”)šł(q©½ng)ģóššŲõHugging Faceé}(c©Īng)Äņ(k©┤)ĪŻ

ĪĪĪĪłD3Ż║“õøå¢(w©©n)”ų¬ūR(sh©¬)į÷ÅŖ(qi©óng)µ£┬Ę

ĪĪĪĪ3.2.2 Ųõ╦¹ā×(y©Łu)╗»ĘĮŽ“

ĪĪĪĪ│²┴╦Embedding▓┐ĘųŻ¼“LangChain+LLM”(łD2)µ£┬Ęā╚(n©©i)Ą─Ųõ╦¹ĮM╝■ę▓ėą▀M(j©¼n)ę╗▓Įā×(y©Łu)╗»Ą─┐šķgŻ║

ĪĪĪĪ1. ų¬ūR(sh©¬)Äņ(k©┤)╝Ü(x©¼)╗»

ĪĪĪĪ«ö(d©Īng)ė├æ¶╩ųäė(d©░ng)▀xō±Ęųģ^(q©▒)║¾Ż¼Ęųģ^(q©▒)Öz╦„┐╔ęį├„’@╠ßĖ▀š┘╗žĄ─Š½Č╚ĪŻ

ĪĪĪĪłD4Ż║“õøå¢(w©©n)”Ą─Į╗╗źĮń├µ

ĪĪĪĪ2. ╬─▒ŠŪąĘųĘĮ╩Į

ĪĪĪĪė╔ė┌╬─▒Šųž»B(overlap)Ą─┤¾ąĪø](m©”i)ėąĮy(t©»ng)ę╗ś╦(bi©Īo)£╩(zh©│n)Ż¼╚ń║╬▒ŻūCšZ(y©│)┴x═Ļš¹║═▀Bž×Č╝ąĶę¬▓╗öÓ£y(c©©)įćĪŻ

ĪĪĪĪ3. ╠ß╩Šį~Ą─┘|(zh©¼)┴┐

ĪĪĪĪį┌╠ß╩Šį~─Ż░ÕĄ─įO(sh©©)ėŗ(j©¼)╔Žę¬į÷╝ė├„┤_╝s╩°Śl╝■Ą─ųĖ┴ŅŻ¼£p╔┘┤¾─Żą═│÷¼F(xi©żn)╗├ėX(ju©”)¼F(xi©żn)Ž¾Ą─Äū┬╩ĪŻ

ĪĪĪĪ4. ┤¾─Żą═Ą─▀xą═

ĪĪĪĪ▀xō±╗∙ū∙─Żą═▀Ć╩Ū╬óš{(di©żo)║¾Ą──Żą═Ż¼ęį╝░ī”(du©¼)ųą╬─Ą─ų¦│ų│╠Č╚Ą─ąĶŪ¾Č╝ąĶę¬ĮY(ji©”)║ŽŽ┬ė╬ł÷(ch©Żng)Š░▀M(j©¼n)ąą┼ąäeĪŻ

ĪĪĪĪ▒ŠŲ┌╬─š┬Ħ─Ń╗∙ė┌“LangChain+LLM”┐“╝▄┐ņ╦┘┤ŅĮ©┴╦ų¬ūR(sh©¬)į÷ÅŖ(qi©óng)║¾Ą─å¢(w©©n)┤ÖC(j©®)Ų„╚╦--ą─ņ`»¤ė·Ä¤Ż¼▓ó╠Įėæ┴╦╠ß╔²─Żą═Ą─ā╚(n©©i)╚▌└ĒĮŌ║═ł╠(zh©¬)ąą─▄┴”Ą─Øōį┌ā×(y©Łu)╗»ĘĮŽ“ĪŻŽ┬Ų┌╬─š┬╬ęéāīó╔Ņ╚ļĮŌūx─┐Ū░ų„┴„Ą─┤¾─Żą═╬óš{(di©żo)╝╝ąg(sh©┤)Ż¼Š┤šł(q©½ng)Ų┌┤²Ī½

ĪĪĪĪ4 ģó┐╝╬─½I(xi©żn)

ĪĪĪĪ[1] LangChain Docs: https://python.langchain.com/docs/modules/

ĪĪĪĪ[2] Revolutionizing NLP: Building Advanced Applications with LangChain and LLMs: https://www.linkedin.com/pulse/revolutionizing-nlp-building-advanced-applications-chandan/

ĪĪĪĪ[3] Zilliz gitee: https://zilliz.gitee.io/welcome/

ĪĪĪĪ[4] GanymedeNil/text2vec-large-chinese: https://huggingface.co/GanymedeNil/text2vec-large-chinese

ĪĪĪĪ[5] MTEB Leaderboard: https://huggingface.co/spaces/mteb/leaderboard

ĪĪĪĪ[6] õøå¢(w©©n) (wisdomInterrogatory) github: https://github.com/zhihaiLLM/wisdomInterrogatory

ĪĪĪĪąąśI(y©©)┘YėŹĪóŲ¾śI(y©©)äė(d©░ng)æB(t©żi)ĪóśI(y©©)Įńė^³c(di©Żn)ĪóĘÕĢ■(hu©¼)╗Ņäė(d©░ng)┐╔░l(f©Ī)╦═Ó]╝■ų┴news#citmt.cnŻ©░č#ōQ│╔@Ż®ĪŻ

║Żł¾(b©żo)╔·│╔ųą...